欢迎关注“类人哲学”,评论或私信,一起聊聊人工智能哲学的小事。

根本上,我认为大师们的思考是以一种"黑盒"的方式研究大脑的活动,现代脑科学是以一种白盒的方式研究大脑活动。而人工智能设计是以"同构"的方式来研究"智能的结构"。最终,三种道路殊途同归,或者,三种方式都永无结果。

按时间先后顺序,哲学大师们对于外在世界和内在世界的观点如下

1. 柏拉图。感官世界和理念世界。理念世界是真正的存在,比如脑子中的“马”的概念才是真正的存在,现实中的马则千变万化。

2. 亚里士多德不同意他的老师柏拉图,认为感觉到的世界才是真实存在。

3. 笛卡尔说,外在世界是不是真的不确定,因为外在世界是我们感受到的产物,而感官是靠不住的。但有一点是肯定的,就是我思考的时候,我一定是存在的,我思故我在。

4. 洛克说,我思故我在只能证明自己存在,别的什么也证明不出来。要获得知识,就要观察、实验、归纳,这样的知识才是真正的存在。

5. 贝克莱简化说,存在,就是被感知。这和王阳明的“汝未看此花时,此花与汝同归于寂。汝来看此花时,此花颜色一时明白过来”是一样的。那些永远感知不到的东西,就是不存在。

6. 休谟说,世界是不可知的。因为1)客观世界不可知,2)主观世界得到的知识也是不靠谱的(1000只天鹅是白的,所有天鹅是白的论断仍是不可靠的)。

7. 康德说,我们的头脑不是白板,而是天生带着认知功的,我们只能按照这种认知功能去认识世界,我们可以依靠这种认知功能去不断认识这个世界,当然,我们也只能以人天生具有的认知功能去认识这个世界。

到这里,这些站在“智能结构”这个黑盒外面的哲学大师们关于存在的讨论基本已经到顶峰了。而接下来的时间,是科学的迅猛发展,世界的本质已不重要了,形而上学的讨论已经进入低谷,能真正发明创造出来实实在在的东西的科学技术迎来了高潮。

深度学习已经在语音识别、图像识别等领域取得突破。深度学习全称深度神经网络,本质上是多层次的人工神经网络算法,即从结构上模拟人脑的运行机制,从最基本的单元上模拟了人类大脑的运行机制。

深度学习已经开始在计算机视觉、语音识别、自然语言理解等领域取得了突破。在语音识别领域,2010 年,使用深度神经网络模型的语音识别相对传统混合高斯模型识别错误率降低超过 20%,目前所有的商用语音识别算法都基于深度学习。在图像分类领域,目前针对ImageNet 数据集的算法分类精度已经达到了 95%以上,可以与人的分辨能力相当。深度学习在人脸识别、通用物体检测、图像语义分割、自然语言理解等领域也取得了突破性的进展。

海量的数据和高效的算力支撑是深度学习算法实现的基础。深度学习分为训练(training)和推断(inference)两个环节。训练需要海量数据输入,训练出一个复杂的深度神经网络模型。推断指利用训练好的模型,使用待判断的数据去“推断”得出各种结论。大数据时代的到来, 图形处理器(Graphics Processing Unit,GPU)等各种更加强大的计算设备的发展,使得深度学习可以充分利用海量数据(标注数据、弱标注数据或无标注数据),自动地学习到抽象的知识表达,即把原始数据浓缩成某种知识。

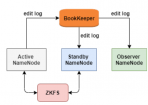

当前基于深度学习的人工智能技术架构如下图所示:

总体来看,深度神经网络对计算芯片的需求主要有以下两个方面:一是计算芯片和存储间海量数据通信需求,这里有两个层面,一个是 缓存(Cache)和片上存储(Memory)的要大,另一个是计算单元和存储之间的数据交互带宽要大。二是专用计算能力的提升,解决对卷 积、残差网络、全连接等计算类型的大量计算需求,在提升运算速度 的同时实现降低功耗。总的来说,AI 计算芯片的发展过程可以总结为一直在围绕如何有效解决存储与计算单元的提升这两个问题而展 开,成本问题则作为一个舵手控制着最终的航向。

国内寒武纪,其 DianNao 系列核心思想为结合神经网络模型的数据局部性特点以及计算特性,进行存储体系以及专用硬件设计,从而获取更好的性能加速比以及计算功耗比。

未来几年内,全球人工智能芯片的市场规模将由2018年的51亿美元增长到2025年的726亿美元,年均复合增长率将达到46.14%。另根据Gartner预测,2022年全球AI芯片的市场规模将从2018年的42.7亿美元上升到2023年的323亿美元,2019-2023年平均增速约为50%。中国人工智能芯片市场规模将保持40%-50%的增长速度,到2024年,市场规模将达到785亿元。随着智能终端的普及以及万物互联的趋势形成,人工智能算力将发挥越来越重要的作用,人工智能芯片将迎来巨大的发展机遇。

原创声明:如需转载,请注明“类人哲学”,谢谢!